Categoría: Article

-

Control de la Actividad de las Bases de Datos: El Estado del Mercado

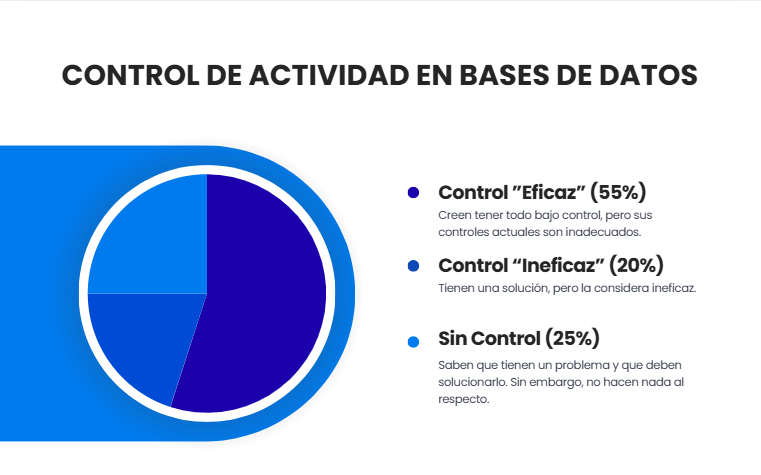

Recientemente hemos realizado una encuesta para comprobar el estado del mercado de la seguridad de bases de datos, centrándonos en el control de la actividad. Los resultados ofrecen una visión fascinante de la mentalidad de los profesionales de la seguridad. Empecemos con la buena noticia inequívoca: todos los encuestados creen que controlar la actividad de…

-

Encuesta de Enmascaramiento

En una encuesta reciente, preguntamos a profesionales de ciberseguridad si enmascaran sus datos. Los resultados no sorprenden. El 90 % de los encuestados afirmó que el enmascaramiento de datos es importante. El 40 % ya enmascara sus datos y cerca del 50 % necesita enmascararlos, pero aún no lo ha hecho. Solo un 10 %…

-

Serie de seminarios web educativos: Seguridad avanzada de bases de datos

Serie de Webinars Educativos Gratuitos: Seguridad Avanzada de Bases de Datos Esta serie de seminarios web educativos y gratuitos ofrece una visión profunda sobre cómo proteger las bases de datos. En cada sesión, guiamos a los asistentes a través de conceptos clave, mostramos ejemplos concretos y, en muchos casos, compartimos cómo se ve una implementación…

-

Serie de Webinars EducativosCumplimiento Normativo de BBDD

Esta serie de seminarios web educativos gratuitos ofrece una visión detallada del cumplimiento normativo en bases de datos. Con el apoyo de la división de investigación de BCR, los expertos de DBLandIT explorarán la aplicación práctica de diferentes normativas de cumplimiento en bases de datos. Aunque cada sesión se inspira en una normativa o un…

-

Presupuestos de Ciberseguridad y Su Significado

Una encuesta reciente de Blue Core Research muestra un patrón interesante en los presupuestos de ciberseguridad. Aproximadamente la mitad de las empresas (47%) aumentaron su presupuesto de ciberseguridad, mientras que la otra mitad mostró una tendencia negativa. Dentro de esta tendencia negativa, aproximadamente una cuarta parte no modificó su presupuesto, la otra mitad lo redujo…

-

Seguridad de Bases de Datos: ¿De Quién es el Trabajo?

La seguridad de bases de datos a menudo se percibe como un rincón oscuro de IT, que requiere conocimientos arcanos que muchos equipos de seguridad no se sienten capacitados para manejar. La pregunta «¿De quién es el trabajo?» y «¿Por dónde empezamos?» cobra gran importancia, lo que a veces genera una sensación de parálisis. La…

-

Enmascaramiento de datos, anonimización, ofuscación y privacidad

En un mundo dominado por datos y con amenazas acechando por todas partes, mantener la seguridad de los datos es casi imposible. Sin embargo, este desafío se agrava al copiar los datos para pruebas, desarrollo, capacitación, etc. Si proteger los datos en producción es difícil, proteger estas copias fuera del entorno de producción seguro es…

-

Seguridad de BBDD: Entrevista con el CTO de BCR

En una entrevista exclusiva, hablamos con Eyal Kalderon, fundador y director de tecnología de Blue Core Research, para comprender mejor el estado actual de la seguridad de las bases de datos. Eyal, llevas más de 30 años trabajando con tecnologías avanzadas de bases de datos y las últimas dos décadas te has centrado en la…

-

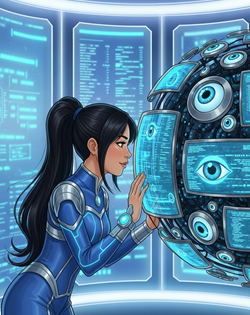

El Misterio de los Sparkle-Bits Perdidos

El Misterio de los Sparkle-Bits Perdidos La aventura de Aella es un ejemplo perfecto de buenas prácticas de seguridad de datos. Si logras replicar su ejemplo, probablemente evitarás una filtración de datos. Analicemos las conclusiones clave y cómo puedes replicar esta historia ficticia en la vida real. El Evento de Seguridad Un día, Aella, guardiana…

-

¿La seguridad de las BBDD es un lujo inasequible?

Introducción Lo entendemos. Cuando los presupuestos son ajustados y el panorama de amenazas parece expandirse a diario, la idea de una seguridad «suficientemente buena» puede ser tentadora. Defensas perimetrales, protección de endpoints: se sienten tangibles, como muros que rodean tu reino digital. ¿Seguridad de bases de datos? A menudo se percibe como compleja, costosa y……